Специалисты Центра искусственного интеллекта МГУ совместно с коллегами из лаборатории компьютерной графики и мультимедиа факультета ВМК МГУ и Института искусственного интеллекта МГУ представили уникальную платформу. Она тестирует устойчивость алгоритмов распознавания синтетических изображений, известных как дипфейки, к методам их маскировки, таким как интенсивное сжатие. Проект проходит в рамках соревнований NTIRE на конференции CVPR, признанном мировом лидере по импакт фактору.

Цель: Преодоление Разрыва между Лабораторией и Реальностью

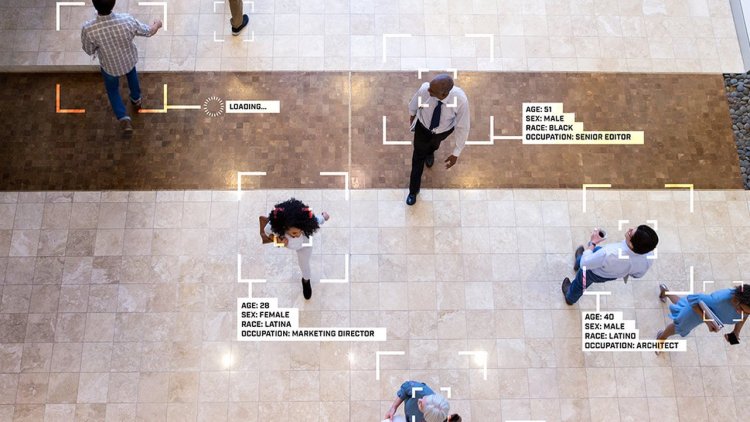

Главная задача проверить, сохраняют ли детекторы точность после распространения изображений через соцсети. В реальной жизни фото подвергаются сжатию, обрезке, коррекции цветов и другим преобразованиям. Эти манипуляции серьезно снижают эффективность алгоритмов.

Мощный Инструмент Тестирования

Для оценки создан обширный набор данных, содержащий изображения, сгенерированные 42 разными моделями. Испытания включают 18 видов цифровых искажений, в том числе сжатие стандартами JPEG 2000 и новейшим JPEG AI. Рейтинг строят на результатах работы алгоритмов после этих воздействий, измеряя устойчивость к изменениям данных и к каждому преобразованию в отдельности.

Акцент на Сложные Кейсы

Дмитрий Ватолин, старший научный сотрудник ЦИИ МГУ, руководитель лаборатории Интеллектуальный анализ видео, пояснил: В идеальных условиях детекторы показывают отличные результаты. Но после многочисленных пересылок в соцсетях или мессенджерах изображения нередко сжимают так, что детали исчезают. Наш конкурс фокусировался именно на таких сложных случаях, включая применение новых стандартов, как JPEG AI, утвержденный только в сентябре прошлого года.

Поддержка Профессионального Сообщества

Александр Крайнов, директор по развитию технологий искусственного интеллекта в Яндексе, подчеркнул: Генерация изображений открывает огромные возможности, но во многих задачах критически важно отличать синтетику от реальности. Для этого нужны надежные методы оценки алгоритмов и качественные датасеты для их обучения. Вот почему мы поддерживаем коллег из МГУ в организации этого глобального вызова и искренне восхищены достижениями.

Честная Конкуренция и Генерализация

В рамках конкурса представлен усложненный пакет данных Hard Validation. Его цель проверить способность моделей к генерализации и снизить риск переобучения на конкретных тестовых данных. Для повышения объективности оценок число ежедневных попыток отправки решений строго ограничено.

Глобальный Успех

В конкурсе участвовало свыше 500 команд по всему миру с общим числом решений более 3400. Наборы данных открыты на исследовательской платформе HuggingFace (deepfakesMSU). Победительскую таблицу возглавили Ant Group. За ними расположились ChinaTelecom, INTSIG Information Co, молодой китайский аспирант, команда University of Electronic Science and Technology of China и Reagvis Labs из Индии.

Работа проведена с привлечением суперкомпьютера МГУ-270. Ее итоги опубликуют в статье на CVPR, где сравнивается устойчивость алгоритмов детекции дипфейков к разным цифровым изменениям. Уже собран уникально крупный датасет для тренировки и испытания детекторов, претендующий на мировое лидерство. Его публикация ожидается до конца года.

Светлое Будущее Защиты От Дипфейков

Проект МГУ и его партнеров ярко демонстрирует флагманские решения в области искусственного интеллекта. Яркий прорыв в создании устойчивых алгоритмов детекции дипфейков открывает новые горизонты для безопасного и доверительного использования цифровых медиа.

Источник: scientificrussia.ru